Регрессия (Regression) · Loginom Wiki

Loginom: Логистическая регрессия (обработчик), Линейная регрессия (обработчик)

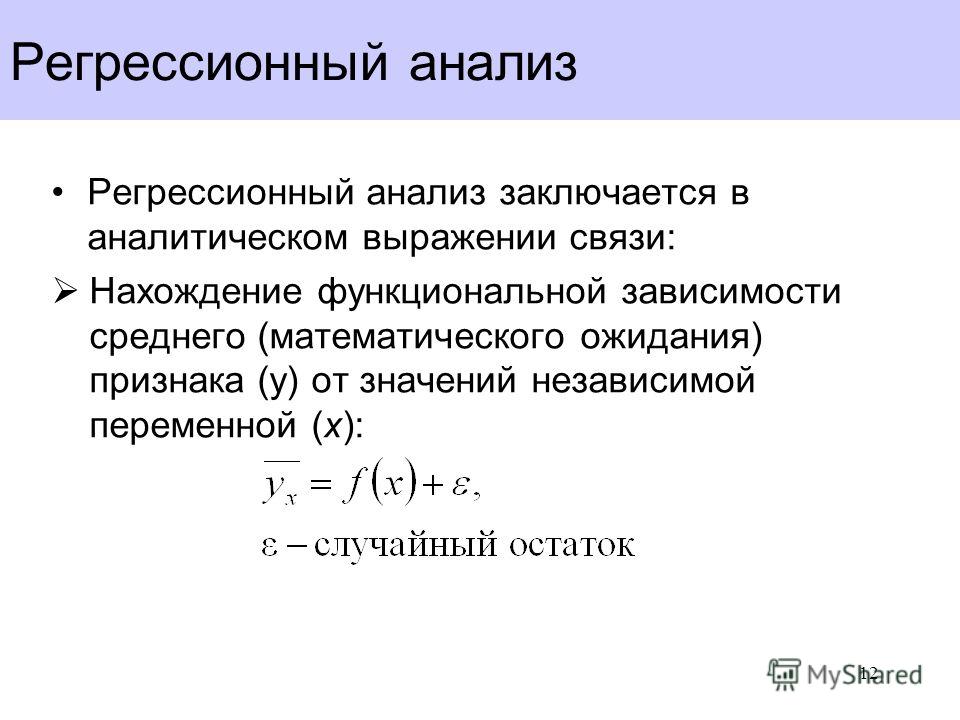

В теории вероятности и математической статистике это зависимость математического ожидания случайной величины от одной или нескольких других случайных величин.

В отличие от чисто функциональной зависимости y=f(x), где каждому значению независимой переменной x соответствует единственное значение зависимой переменной y, регрессионная зависимость предполагает, что каждому значению переменной x могут соответствовать различные значения y, обусловленные случайной природой зависимости.

Если некоторому значению величины xi соответствует набор значений величин yi1,yi2,…,yin, то зависимость средних арифметических:

¯yi=(yi1,yi2,…,yin)ni

от xi и является регрессией в статистическом понимании данного термина.

Типичным примером регрессионной зависимости может быть зависимость между ростом и весом человека. В большинстве случае вес пропорционален росту, но фактически большой рост не всегда означает большой вес. Иными словами, у роста, например, 175 см. может наблюдаться несколько значений веса, скажем 69, 78 и 86 кг. Тогда зависимость между ростом и средним значением указанных весов будет являться регрессионной.

Изучение регрессии в теории вероятностей основано на том, что случайные величины X и Y, имеющие совместное распределение вероятностей, связаны статистической зависимостью: при каждом фиксированном значении X=x, величина Y является случайной величиной с определённым (зависящим от значения x) условным распределением вероятностей.

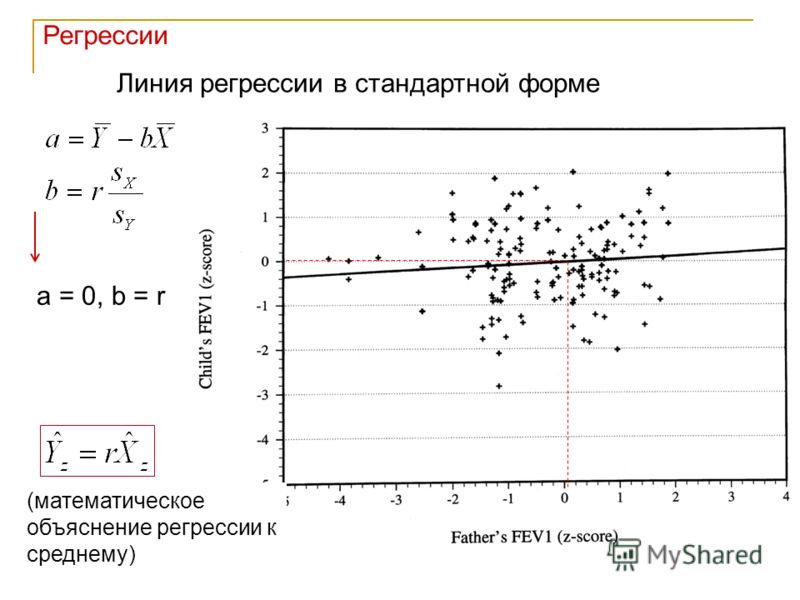

Регрессия величины Y по величине X определяется условным математическим ожиданием Y, вычисленным при условии, что X=x:E(Y|x)=u(x).

Уравнение y=u(x) называется уравнением регрессии, а соответствующий график — линией регрессии Y по X. Точность, с которой уравнение Y по X отражает изменение Y в среднем при изменении x, измеряется условной дисперсией D величины Y, вычисленной для каждого значения X=x:D(Y|x)=D(x).

Если D(x)=0 при всех значениях x, то можно достоверно утверждать, что Y и X связаны строгой функциональной зависимостью Y=u(X). Если D(x)=0 при всех значениях x и u(x) не зависит от x, то говорят, что регрессионная зависимость Y по X отсутствует.

Линии регрессии обладают следующим замечательным свойством

Это означает, что регрессия Y по X даёт наилучшее в указанном смысле представление величины Y по величине X. Это свойство позволяет использовать регрессию для предсказания величины Y по X.

Иными словами, если значение Y непосредственно не наблюдается и эксперимент позволяет регистрировать только X, то в качестве прогнозируемого значения Y можно использовать величину Y=u(X).

Наиболее простым является случай, когда регрессионная зависимость Y по X линейна, т.е. E(Y|x)=b0+b1x, где b0 и b1 – коэффициенты регрессии. На практике обычно коэффициенты регрессии в уравнении y=u(x) неизвестны, и их оценивают по наблюдаемым данным.

Регрессия широко используется в аналитических технологиях при решении различных бизнес-задач, таких как прогнозирование (продаж, курсов валют и акций), оценивание различных бизнес-показателей по наблюдаемым значениям других показателей (скоринг), выявление зависимостей между показателями и т.д.

Регрессионный анализ—ArcGIS Insights | Документация

Регрессионный анализ статистический аналитический метод, позволяющий вычислить предполагаемые отношения между зависимой переменной одной или несколькими независимыми переменными. Используя регрессионный анализ, вы можете моделировать отношения между выбранным переменными, а также прогнозируемыми значениями на основе модели.

Обзор регрессионного анализа

Регрессионный анализ использует выбранный метод оценки, зависимую переменную и одну или несколько независимых переменных для создания уравнения, которое оценивает значения зависимой переменной.

Модель регрессии включает выходные данные, например R2 и p-значения, по которым можно понять, насколько хорошо модель оценивает зависимую переменную.

Диаграммы, например матрица точечной диаграммы, гистограмма и точечная диаграмма, также используются в регрессионном анализе для анализа отношений и проверки допущений.

Регрессионный анализ используется для решения следующих типов проблем:

- Выявить, какая независимая переменная связана с зависимой.

- Понять отношения между зависимой и независимыми переменными.

- Предсказать неизвестные значения зависимой переменной.

Примеры

Аналитик в рамках исследования для небольшой розничной сети изучает эффективность работы различных магазинов. Он хочет выяснить, почему некоторые магазины показывают очень небольшой объем продаж. Аналитик строит модель регрессии с независимыми переменными, такими как средний возраст и средний доход жителей, проживающих вокруг магазинов, а так же расстояние до торговых центров и остановок общественного транспорта, чтобы выявить, какая именно переменная наиболее влияет на продажи.

Аналитик департамента образования исследует эффективность новой программы питания в школе. Аналитик строит модель регрессии для показателей успеваемости, используя такие независимые переменные, как размер класса, доход семьи, размер подушевого финансирования учащихся и долю учащихся, питающихся в школе. Уравнение модели используется для выявления относительного вклада каждой переменной в показатели успеваемости учебного заведения.

Аналитик неправительственной организации изучает эффект глобальных выбросов парниковых газов. Аналитик строит модель регрессии для выбросов в последнее время, зафиксированных в каждой стране, используя независимые переменные, такие как валовой внутренний продукт( ВВП), численность населения, производство электроэнергии с использованием добываемого углеводородного топлива и использование транспортных средств.

Метод наименьших квадратов

Регрессионный анализ в ArcGIS Insights моделируется на основе Метода наименьших квадратов (МНК).

МНК – форма множественной линейной регрессии, допускающей, что отношения между зависимыми и независимыми переменными должны моделироваться подгонкой линейного уравнения к данным наблюдений.

МНК использует следующее уравнение:

yi=β0+β1x1+β2x2+...+βnxn+ε, где:

- yi=наблюдаемое=наблюдаемое значение независимой переменной в точке i

- β0=y-интерсепт (отрезок на координатной оси, постоянное значение)

- βn=коэффициент регрессии или уклона независимой переменной N в точке i

- xn=значение переменной N в точке i

- ε=ошибка уравнения регрессии

Допущения (Предположения)

Каждый метод регрессии имеет несколько допущений, которые должны быть выполнены для того, чтобы уравнение считалось надежным. Допущения МНК должны быть проверены при создании модели регрессии.

Следующие допущения должны быть проверены и удовлетворены при использовании метода МНК:

Модель должна быть линейной.

Регрессия МНК используется только при построении линейной модели. Линейную зависимость между зависимой и независимыми переменными можно проверить используя точечную диаграмму (рассеивания). Матрица точечной диаграммы может проверить все переменные, при условии, что всего используется не более 5 переменных.

Данные должны быть распределены произвольно.

Данные, используемые в регрессионном анализе, должны быть произвольно распределены, то есть выборки данных не должны зависеть от какого-либо внешнего фактора. Произвольное распределение можно проверить, используя невязки в модели регрессии. Невязки, рассчитываемые как результат модели регрессии, не должны коррелировать при нанесении их на точечную диаграмму или матрицу точечной диаграммы вместе с независимыми переменными.

Произвольное распределение можно проверить, используя невязки в модели регрессии. Невязки, рассчитываемые как результат модели регрессии, не должны коррелировать при нанесении их на точечную диаграмму или матрицу точечной диаграммы вместе с независимыми переменными.

Независимые переменные не должны быть коллинеарны.

Коллинеарность — это линейная связь между независимыми переменными, которая создает избыточность в модели. В ряде случаев модель создается с коллинеарностью. Тем не менее, если одна из коллинеарных переменных зависит от другой, возможно, стоит удалить ее из модели. Оценить коллинеарность можно с помощью точечной диаграммы или матрицы точечной диаграммы независимых переменных.

Независимые переменные должны иметь незначительную погрешность измерения.

Точность модели регрессии соответствует точности входных данных. Если независимые переменные имеют большой разброс ошибок, модель нельзя считать точной. При выполнении регрессионного анализа очень важно использовать наборы данных только из известных и доверенных источников, чтобы быть уверенным в незначительности ошибок.

Предполагаемая сумма невязок должна быть равна нулю.

Невязки представляют собой разность между ожидаемыми и наблюдаемыми значениями в регрессионном анализе. Наблюдаемые значения выше кривой регрессии имеют положительное значение невязки, а значения ниже кривой регрессии – отрицательные. Кривая регрессии должны проходить через центр точек данных; соответственно сумма невязок должны стремиться к нулю. Сумму значений поля можно вычислить в суммарной таблице.

Невязки должны иметь равномерную вариабельность.

Величина вариабельности должна быть одинаковой для всех невязок. Это допущение проверяется с использованием точечной диаграммы невязок (ось y) и оцениваемых значений (ось x). Результирующая точечная диаграмма отображается как горизонтальная полоса с произвольно разбросанными точками по всей площади.

Распределение невязок должно соответствовать нормальному.

Нормальное распределение – кривая в форме колокола – является естественным распределением, где высокая частота явления наблюдается рядом со средним значением, и по мере увеличения расстояния от среднего частота снижается. В статистическом анализе нормальное распределение часто используется как нулевая гипотеза. Если распределение невязок соответствует нормальному, линия наилучшего соответствия проходит по центру наблюдаемых точек данных, а не отклоняется, приближаясь к одним, и отклоняясь от других. Это допущение можно проверить, построив гистограмму невязок. Кривая нормального распределения может не поместиться в карточку и сдвиги и эксцессы переносятся на обратную сторону карточки гистограммы.

Смежные невязки не должны обнаруживать автокорреляцию.

Это допущение основано на хронологии данных. Если данные соответствуют хронологии, каждая точка данных должна быть независима от предыдущей или последующей точки данных. Поэтому при выполнении регрессионного анализа важно убедиться, что хронологический порядок данных соответствует нормальному ходу времени. Это допущение вычисляется с использованием теста Дарбина-Уотсона.

Тест Дарбина-Уотсона измеряет автокорреляцию невязок в модели регрессии. Критерий Дурбина-Ватсона использует шкалу от 0 до 4, где значения от 0 до 2 указывают на положительную автокорреляцию, 2 – отсутствие автокорреляции, а от 2 до 4 отрицательную автокорреляцию. То есть, чтобы соответствовать допущению об отсутствии автокорреляции невязок, необходимо получить значение, приближающееся к 2. В целом, значения между 1.5 и 2.5 считаются допустимыми, а меньше 1.5 или больше 2.5 указывают на то, что модель не соответствует утверждению об отсутствии автокорреляции.

Пригодность модели

Точность уравнения регрессии – основа регрессионного анализа. Все модели будут иметь некую ошибку, но понимание этой статистики поможет вам определить, можно ли использовать эту модель для вашего анализа, или необходимо выполнить дополнительные преобразования.

Существуют два метода проверки корректности модели регрессии: исследовательский анализ и подтверждающий анализ.

Исследовательский анализ

Исследовательский анализ – технология анализа данных с использованием разнообразных статистических и визуальных методов. В рамках исследовательского анализа вы проверяете допущения регрессии МНК и сравниваете эффективность различных независимых переменных. Исследовательский анализ позволяет вам сравнить эффективность и точность разных моделей, но не может определить, должны ли вы использовать или отклонить ту или иную модель. Исследовательский анализ необходимо проводить перед анализом подтверждения для каждой модели регрессии, возможно, несколько раз, для сравнения разных моделей.

Как часть исследовательского анализа могут быть использованы следующие диаграммы и статистические показатели:

- Точечная диаграмма (рассеяния) и матрица точечной диаграммы

- Гистограмма и анализ нормального распределения

- Уравнение регрессии и прогнозирование новых наблюдений

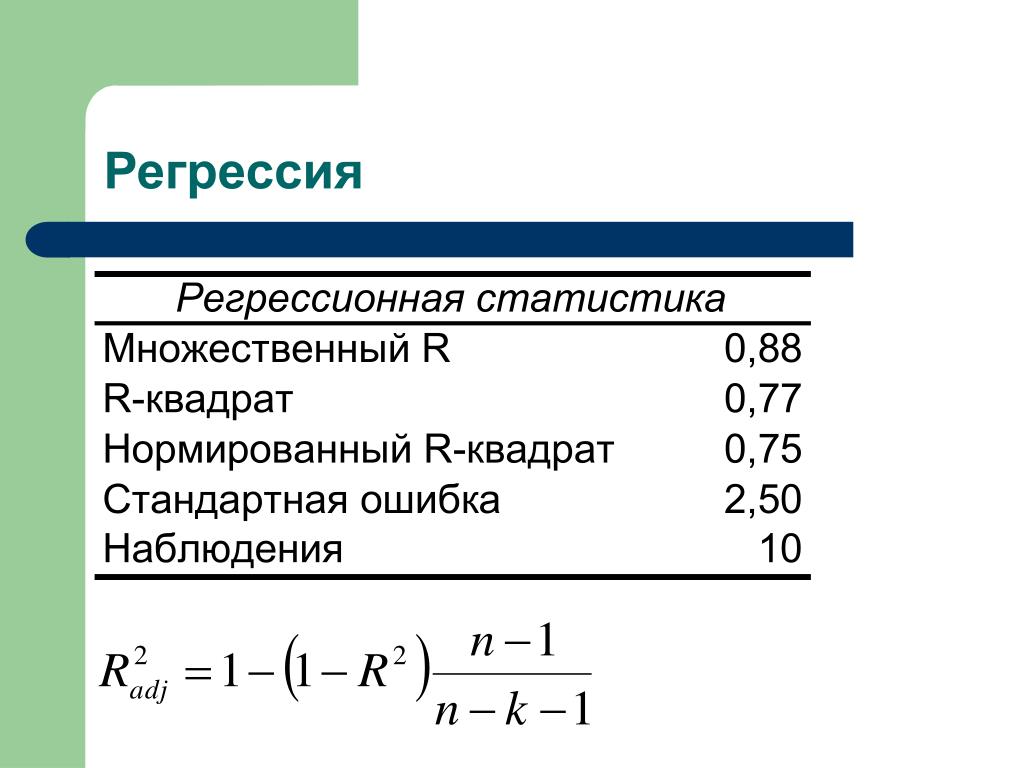

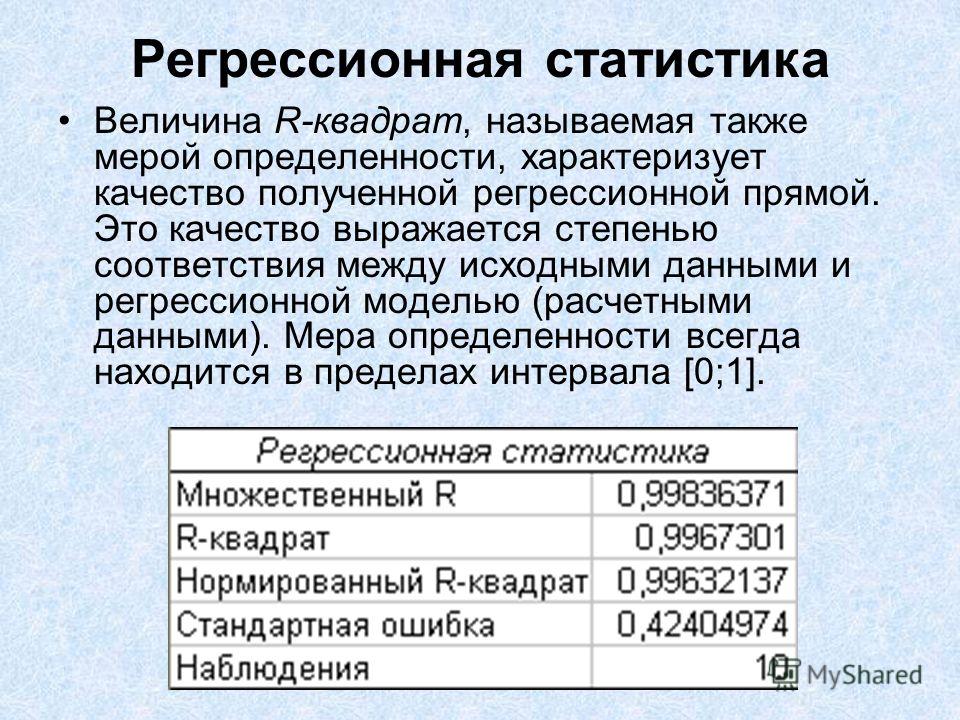

- Коэффициент детерминации, R2 и скорректированный R2

- Стандартная ошибка невязки

- Точечная диаграмма

Исследовательский анализ начинается, когда вы выбираете независимые переменные, и до построения модели регрессии. Так как МНК – метод линейной регрессии, основное допущение – модель должна быть линейной. Точечная диаграмма (рассеяния) и матрица точечной диаграммы могут быть использованы для анализа линейной зависимости между зависимой переменной и независимыми переменными. Матрица точечной диаграммы может отобразить до 4х независимых переменных с зависимой переменной, что позволяет сразу провести сравнение между всеми переменными. Простая диаграмма рассеяния может отобразить только две переменные: одну зависимую и одну независимую. Просмотр диаграммы рассеяния с зависимой переменной и одной независимой переменной позволяет сделать более точное допущение об отношении между переменными. Линейность можно проверить перед созданием модели регрессии, чтобы определить, какие именно независимые переменные следует использовать для создания пригодной модели.

Линейность можно проверить перед созданием модели регрессии, чтобы определить, какие именно независимые переменные следует использовать для создания пригодной модели.

Несколько выходных статистических показателей также доступны после создания модели регрессии, к ним относятся: уравнение регрессии, значение R2 и критерий Дурбина-Ватсона. После создания модели регрессии вы должны использовать выходные показатели, а также диаграммы и таблицы для проверки остальных допущений регрессии МНК. Если ваша модель удовлетворяет допущениям, вы можете продолжить исследовательский анализ.

Уравнение регрессии дает возможность оценить влияние каждой независимой переменной на прогнозируемые значения, включая коэффициент регрессии для каждой независимой переменной. Можно сравнить величины уклона для определения влияния каждой независимой переменной на зависимую переменную; Чем дальше от нуля значение уклона (неважно, в положительную, или отрицательную сторону) – тем больше влияние. Уравнение регрессии также может быть использовано для прогнозирования значений зависимой переменной через вод значений каждой независимой переменной.

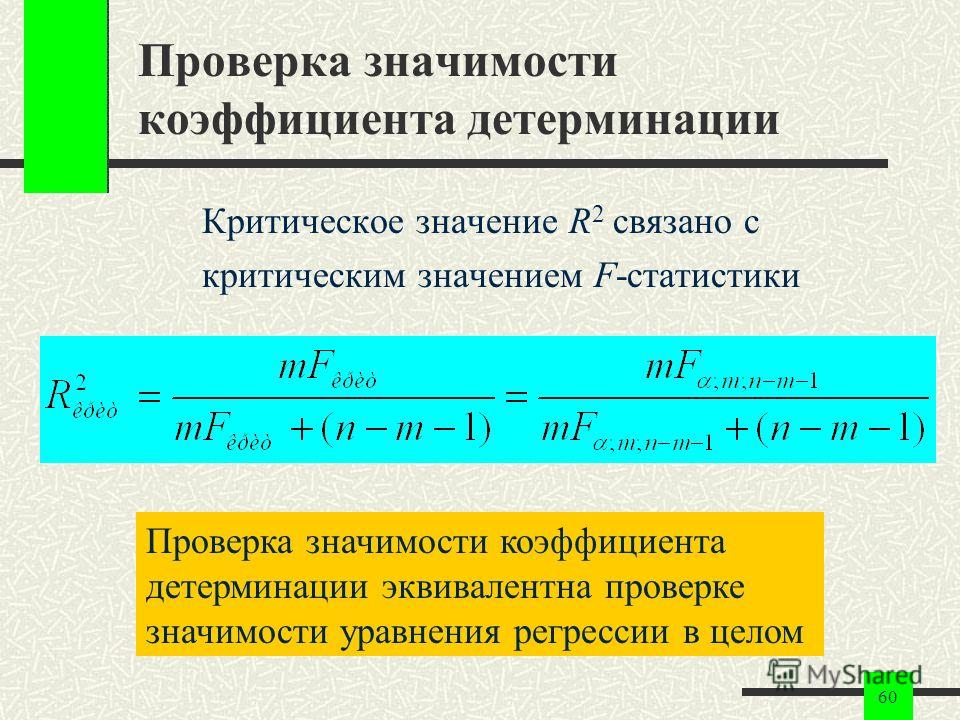

Коэффициент детерминации, обозначаемый как R2, измеряет, насколько хорошо уравнение регрессии моделирует фактические точки данных. Значение R2 – число в диапазоне от 0 до 1, причем, чем ближе значение к 1, тем более точная модель. Если R2 равен 1, это указывает на идеальную модель, что крайне маловероятно в реальных ситуациях, учитывая сложность взаимодействий между различными факторами и неизвестными переменными. Поэтому следует стремиться к созданию регрессионной модели с максимально возможным значением R2 , понимая, что значение не может быть равно 1.

При выполнении регрессионного анализа существует риск создания модели регрессии, имеющей допустимое значение R2, путем добавления независимых переменных, случайным образом показывающих хорошее соответствие. Значение Скорректированный R2, которое также должно находиться в диапазоне между 0 и 1, учитывает дополнительные независимые переменные, уменьшая роль случайности в вычислении. Скорректированный R2 нужно использовать в модели с большим количеством независимых переменных или при сравнении моделей с различным числом независимых переменных.

Скорректированный R2 нужно использовать в модели с большим количеством независимых переменных или при сравнении моделей с различным числом независимых переменных.

Стандартная ошибка невязки измеряет точность, с которой регрессионная модель может предсказывать значения с новыми данными. Меньшие значения указывают на более точную модель, соответственно при сравнении нескольких моделей, та, где это значение самое меньшее из всех – модель, в которой минимизирована стандартная ошибка невязки.

Точечная диаграмма может быть использована для анализа независимых переменных, с целью выявления кластеризации или выбросов, которые могут влиять на точность модели.

Анализ подтверждения

Анализ подтверждения — процесс оценки модели в сравнении с нулевой гипотезой. В регрессионном анализа нулевая гипотеза утверждает, что отношения между зависимой и независимыми переменными отсутствуют. Для модели с отсутствием отношений величина уклона равна 0. Если элементы анализа подтверждения статистически значимы — вы можете отклонить нулевую гипотезу ((другими словами, статистически подтверждается наличие отношений между зависимой и независимыми переменными).

Для определения значимости, как компонента анализа, используются следующие статистические показатели:

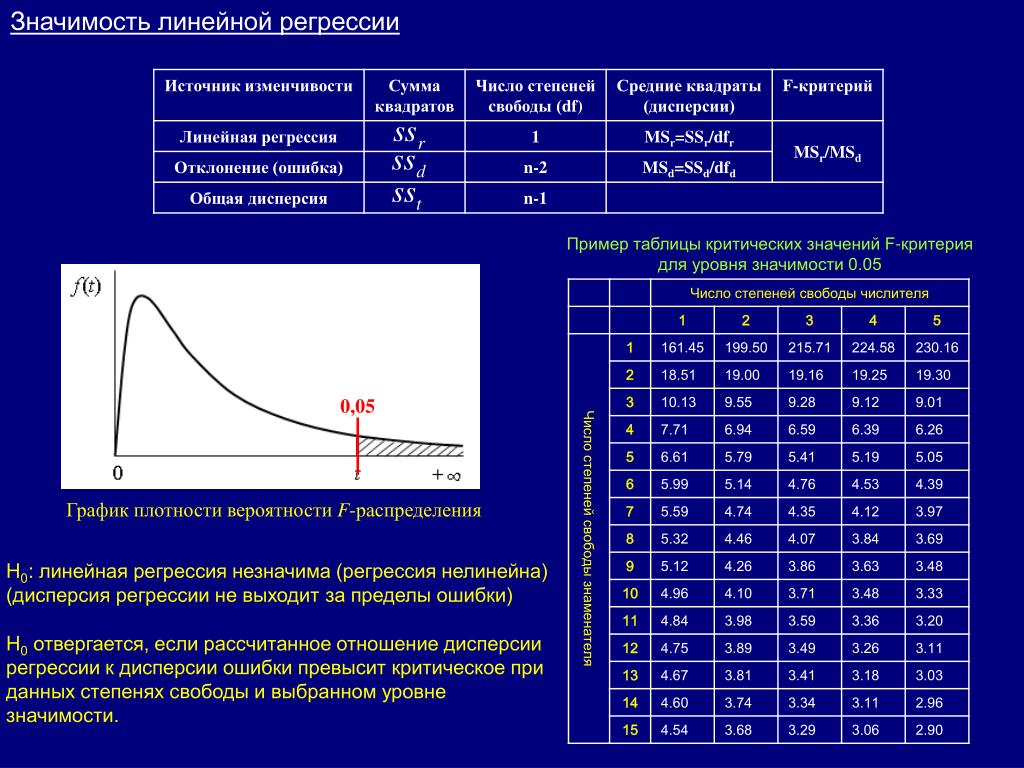

- F-статистика, и связанное с ней p-значение

- T-статистика, и связанное с ней p-значение

- Доверительные интервалы

F-статистика — глобальный статистический показатель, возвращаемый F-критерием, который показывает возможности прогнозирования модели через расчет коэффициентов регрессии в модели, которые значительно отличаются от 0. F-критерий анализирует комбинированное влияние независимых переменных, а не оценивает каждую в отдельности. С F-статистикой связано соответствующее p-значение, которое является мерой вероятности того, что детерминированные отношения между переменными являются случайными Так как p-значения базируются на вероятности, значения располагаются в диапазоне от 0. 0 до 1.0. Небольшое p-значение, обычно 0.05 или меньше, свидетельствует о том, что в модели реально есть отношения между переменными (то есть, выявленная закономерность не является случайной) что дает нам право отвергнуть нулевую гипотезу. В этом случае, вероятность того, что отношения в модели случайны, равна 0.05, или 1 к 20. Или, вероятность того, что отношения реальны, равна 0.95, или 19 к 20.

0 до 1.0. Небольшое p-значение, обычно 0.05 или меньше, свидетельствует о том, что в модели реально есть отношения между переменными (то есть, выявленная закономерность не является случайной) что дает нам право отвергнуть нулевую гипотезу. В этом случае, вероятность того, что отношения в модели случайны, равна 0.05, или 1 к 20. Или, вероятность того, что отношения реальны, равна 0.95, или 19 к 20.

Показатель t-статистика — это локальный статистический показатель, возвращаемый t-критерием, который показывает возможности прогнозирования для каждой независимой переменной отдельно. Так же, как и F-критерий, t-критерий анализирует коэффициенты регрессии в модели, которые значительно отличаются от 0. Так как t-критерий применяется к каждой независимой переменной, модель вернет значение t-статистики для каждой независимой переменной, а не одно значение для всей модели. Каждое значение t-статистики имеет связанное с ним p-значение, которое указывает на значимость независимой переменной. Так же, как и для F-критерия, p-значение для каждого t-критерия должно быть 0.05 или менее, чтобы мы могли отвергнуть нулевую гипотезу. Если p-значение для независимой переменной больше 0.05, эту переменную не стоит включать в модель, и необходимо строить новую модель, даже если глобальное значение вероятности для исходной модели указывает на статистическую значимость.

Доверительные интервалы визуализируют коэффициенты регрессии для каждой независимой переменной и могут быть 90, 95 и 99 процентов. Поэтому доверительные интервалы можно использовать наряду с p-значениями t-критерия для оценки значимости нулевой гипотезы для каждой независимой переменной. Коэффициенты регрессии на должны быть равны 0, только в этом случае вы можете отклонить нулевую гипотезу и продолжить использовать модель. Поэтому, для каждой независимой переменной, коэффициент регрессии, и связанный с ним доверительный интервал не может перекрываться с 0. Если доверительные интервалы в 99 или 95 процентов для данной независимой переменой перекрываются с 0, эта независимая переменная не дает возможности отклонить нулевую гипотезу. Включение этой переменной в модель может негативно повлиять на общую значимость вашей модели. Если только 90-процентный доверительный интервал перекрывается с 0, эта переменная может быть включена в модель, общая статистическая значимость которой вас удовлетворяет. В идеале, доверительные интервалы для всех независимых переменных должны быть как можно дальше от 0.

Включение этой переменной в модель может негативно повлиять на общую значимость вашей модели. Если только 90-процентный доверительный интервал перекрывается с 0, эта переменная может быть включена в модель, общая статистическая значимость которой вас удовлетворяет. В идеале, доверительные интервалы для всех независимых переменных должны быть как можно дальше от 0.

Другие выходные данные

Остальные выходные данные, такие как прогнозируемые значения и невязки также важны для допущений регрессии МНК. В этом разделе вы можете узнать подробнее, как эти значения вычисляются.

Ожидаемые значения

Ожидаемые значения вычисляются на основе уравнения регрессии и значений каждой независимой переменной. В идеале, ожидаемые значения должны совпадать с наблюдаемыми (реальными значениями зависимой переменной).

Ожидаемые значения, вместе с наблюдаемым значениями, используются для вычисления невязок.

Невязки

Невязки в регрессионном анализе – это различия между наблюдаемыми значениями в наборе данных и ожидаемыми значениями, вычисленными с помощью уравнения регрессии.

Невязки A и B для отношений выше вычисляются следующим образом:

residualsA = observedA - estimatedA residualsA = 595 - 487.62 residualsA = 107.38residualsB = observedB - estimatedB residualsB = 392 - 527.27 residualsB = -135.27Невязки используются для вычисления ошибки уравнения регрессии, а также для проверки некоторых допущений.

Основы регрессионного анализа—ArcGIS Pro | Документация

Набор инструментов Пространственная статистика предоставляет эффективные инструменты количественного анализа пространственных структурных закономерностей. Инструмент Анализ горячих точек, например, поможет найти ответы на следующие вопросы:

- Есть ли в США места, где постоянно наблюдается высокая смертность среди молодежи?

- Где находятся «горячие точки» по местам преступлений, вызовов 911 (см.

рисунок ниже) или пожаров?

рисунок ниже) или пожаров? - Где находятся места, в которых количество дорожных происшествий превышает обычный городской уровень?

Анализ данных звонков в службу 911, показывающий горячие точки (красным), холодные точки (синим) и локализацию пожарных/полиции, ответственных за реагирование (зеленые круги)

Каждый из вопросов спрашивает «где»? Следующий логический вопрос для такого типа анализа – «почему»?

- Почему в некоторых местах США наблюдается повышенная смертность молодежи? Какова причина этого?

- Можем ли мы промоделировать характеристики мест, на которые приходится больше всего преступлений, звонков в 911, или пожаров, чтобы помочь сократить эти случаи?

- От каких факторов зависит повышенное число дорожных происшествий? Имеются ли какие-либо возможности для снижения числа дорожных происшествий в городе вообще, и в особо неблагополучных районах в частности?

Инструменты в наборе инструментов Моделирование пространственных отношений помогут вам ответить на вторую серию вопросов «почему». К этим инструментам относятся Метод наименьших квадратов и Географически взвешенная регрессия.

Пространственные отношения

Регрессионный анализ позволяет вам моделировать, проверять и исследовать пространственные отношения и помогает вам объяснить факторы, стоящие за наблюдаемыми пространственными структурными закономерностями. Вы также можете захотеть понять, почему люди постоянно умирают молодыми в некоторых регионах страны, и какие факторы особенно влияют на особенно высокий уровень диабета. При моделирование пространственных отношений, однако, регрессионный анализ также может быть пригоден для прогнозирования. Моделирование факторов, которые влияют на долю выпускников колледжей, на пример, позволяют вам сделать прогноз о потенциальной рабочей силе и их навыках. Вы также можете использовать регрессионный анализ для прогнозирования осадков или качества воздуха в случаях, где интерполяция невозможна из-за малого количества станций наблюдения (к примеру, часто отсутствую измерительные приборы вдоль горных хребтов и в долинах).

МНК – наиболее известный метод регрессионного анализа. Это также подходящая отправная точка для всех способов пространственного регрессионного анализа. Данный метод позволяет построить глобальную модель переменной или процесса, которые вы хотите изучить или спрогнозировать (уровень смертности/осадки). Он создает уравнение регрессии, отражающее происходящий процесс. Географически взвешенная регрессия (ГВР) — один из нескольких методов пространственного регрессионного анализа, все чаще использующегося в географии и других дисциплинах. Метод ГВР (географически взвешенная регрессия) создает локальную модель переменной или процесса, которые вы прогнозируете или изучаете, применяя уравнение регрессии к каждому пространственному объекту в наборе данных. При подходящем использовании, эти методы являются мощным и надежным статистическим средством для проверки и оценки линейных взаимосвязей.

Линейные взаимосвязи могут быть положительными или отрицательными. Если вы обнаружили, что количество поисково-спасательных операций увеличивается при возрастании среднесуточной температуры, такое отношение является положительным; имеется положительная корреляция. Другой способ описать эту положительную взаимосвязь — сказать, что количество поисково-спасательных операций уменьшается при уменьшении среднесуточной температуры. Соответственно, если вы установили, что число преступлений уменьшается при увеличении числа полицейских патрулей, данное отношение является отрицательным. Также, можно выразить это отрицательное отношение, сказав, что количество преступлений увеличивается при уменьшении количества патрулей. На рисунке ниже показаны положительные и отрицательные отношения, а также случаи, когда две переменные не связаны отношениями:

Диаграммы рассеяния: положительная связь, отрицательная связь и пример с 2 не связанными переменными.Корреляционные анализы, и связанные с ними графики, отображенные выше, показывают силу взаимосвязи между двумя переменными. С другой стороны, регрессионные анализы дают больше информации: они пытаются продемонстрировать степень, с которой 1 или более переменных потенциально вызывают положительные или негативные изменения в другой переменной.

С другой стороны, регрессионные анализы дают больше информации: они пытаются продемонстрировать степень, с которой 1 или более переменных потенциально вызывают положительные или негативные изменения в другой переменной.

Применения регрессионного анализа

Регрессионный анализ может использоваться в большом количестве приложений:

- Моделирование числа поступивших в среднюю школу для лучшего понимания факторов, удерживающих детей в том же учебном заведении.

- Моделирование дорожных аварий как функции скорости, дорожных условий, погоды и т.д., чтобы проинформировать полицию и снизить несчастные случаи.

- Моделирование потерь от пожаров как функции от таких переменных как степень вовлеченности пожарных департаментов, время обработки вызова, или цена собственности. Если вы обнаружили, что время реагирования на вызов является ключевым фактором, возможно, существует необходимость создания новых пожарных станций. Если вы обнаружили, что вовлеченность – главный фактор, возможно, вам нужно увеличить оборудование и количество пожарных, отправляемых на пожар.

Существует три первостепенных причины, по которым обычно используют регрессионный анализ:

- Смоделировать некоторые явления, чтобы лучше понять их и, возможно, использовать это понимание для оказания влияния на политику и принятие решений о наиболее подходящих действиях. Основная цель — измерить экстент, который при изменениях в одной или более переменных связанно вызывает изменения и в другой. Пример. Требуется понять ключевые характеристики ареала обитания некоторых видов птиц (например, осадки, ресурсы питания, растительность, хищники) для разработки законодательства, направленного на защиту этих видов.

- Смоделировать некоторые явления, чтобы предсказать значения в других местах или в другое время. Основная цель — построить прогнозную модель, которая является как устойчивой, так и точной.

Пример: Даны прогнозы населения и типичные погодные условия. Каким будет объем потребляемой электроэнергии в следующем году?

Пример: Даны прогнозы населения и типичные погодные условия. Каким будет объем потребляемой электроэнергии в следующем году? - Вы также можете использовать регрессионный анализ для исследования гипотез. Предположим, что вы моделируете бытовые преступления для их лучшего понимания и возможно, вам удается внедрить политические меры, чтобы остановить их. Как только вы начинаете ваш анализ, вы, возможно, имеете вопросы или гипотезы, которые вы хотите проверить:

- «Теория разбитого окна» указывает на то, что испорченная общественная собственность (граффити, разрушенные объекты и т.д.) притягивает иные преступления. Имеется ли положительное отношение между вандализмом и взломами в квартиры?

- Имеется ли связь между нелегальным использованием наркотических средств и взломами в квартиры (могут ли наркоманы воровать, чтобы поддерживать свое существование)?

- Совершаются ли взломы с целью ограбления? Возможно ли, что будет больше случаев в домохозяйствах с большей долей пожилых людей и женщин?

- Люди больше подвержены риску ограбления, если они живут в богатой или бедной местности?

Термины и концепции регрессионного анализа

Невозможно обсуждать регрессионный анализ без предварительного знакомства с основными терминами и концепциями, характерными для регрессионной статистики:

Уравнение регрессии. Это математическая формула, применяемая к независимым переменным, чтобы лучше спрогнозировать зависимую переменную, которую необходимо смоделировать. К сожалению, для тех ученых, кто думает, что х и у это только координаты, независимая переменная в регрессионном анализе всегда обозначается как y, а зависимая – всегда X. Каждая независимая переменная связана с коэффициентами регрессии, описывающими силу и знак взаимосвязи между этими двумя переменными. Уравнение регрессии может выглядеть следующим образом (у – зависимая переменная, Х – независимые переменные, β – коэффициенты регрессии), ниже приводится описание каждого из этих компонентов уравнения регрессии):

Уравнение регрессии может выглядеть следующим образом (у – зависимая переменная, Х – независимые переменные, β – коэффициенты регрессии), ниже приводится описание каждого из этих компонентов уравнения регрессии):

- Зависимая переменная (y) – это переменная, описывающая процесс, который вы пытаетесь предсказать или понять (бытовые кражи, осадки). В уравнении регрессии эта переменная всегда находится слева от знака равенства. В то время, как вы можете использовать регрессию для предсказания зависимой величины, вы всегда начинаете с набора хорошо известных у-значений и используете их для калибровки регрессионной модели. Известные у-значения часто называют наблюдаемыми величинами.

- Независимые переменные (X) это переменные, используемые для моделирования или прогнозирования значений зависимых переменных. В уравнении регрессии они располагаются справа от знака равенства и часто называются независимыми переменными. Зависимая переменная – это функция независимых переменных. Если вас интересует прогнозирование годового оборота определенного магазина, вы можете включить в модель независимые переменные, отражающие, например, число потенциальных покупателей, расстояние до конкурирующих магазинов, заметность магазина и структуру спроса местных жителей.

- Коэффициенты регрессии (β) – это коэффициенты, которые рассчитываются в результате выполнения регрессионного анализа. Вычисляются величины для каждой независимой переменной, которые представляют силу и тип взаимосвязи независимой переменной по отношению к зависимой. Предположим, что вы моделируете частоту пожаров как функцию от солнечной радиации, растительного покрова, осадков и экспозиции склона. Вы можете ожидать положительную взаимосвязь между частотой пожаров и солнечной радиацией (другими словами, чем больше солнца, тем чаще встречаются пожары). Если отношение положительно, знак связанного коэффициента также положителен.

Вы можете ожидать негативную связь между частотой пожаров и осадками (другими словами, для мест с большим количеством осадков характерно меньше лесных пожаров). Коэффициенты отрицательных отношений имеют знак минуса. Когда взаимосвязь сильная, значения коэффициентов достаточно большие (относительно единиц независимой переменной, с которой они связаны). Слабая взаимосвязь описывается коэффициентами с величинами около 0; β0 – это отрезок, отсекаемый линией регрессии.Он представляет ожидаемое значение зависимой величины, если все независимые переменные равны 0.

Вы можете ожидать негативную связь между частотой пожаров и осадками (другими словами, для мест с большим количеством осадков характерно меньше лесных пожаров). Коэффициенты отрицательных отношений имеют знак минуса. Когда взаимосвязь сильная, значения коэффициентов достаточно большие (относительно единиц независимой переменной, с которой они связаны). Слабая взаимосвязь описывается коэффициентами с величинами около 0; β0 – это отрезок, отсекаемый линией регрессии.Он представляет ожидаемое значение зависимой величины, если все независимые переменные равны 0.

P-значения. Большинство регрессионных методов выполняют статистический тест для расчета вероятности, называемой р-значением, для коэффициентов, связанной с каждой независимой переменной. Нулевая гипотеза данного статистического теста предполагает, что коэффициент незначительно отличается от нуля (другими словами, для всех целей и задач, коэффициент равен нулю, и связанная независимая переменная не может объяснить вашу модель). Маленькие величины р-значений отражают маленькие вероятности и предполагают, что коэффициент действительно важен для вашей модели со значением, существенно отличающимся от 0 (другими словами, маленькие величины р-значений свидетельствуют о том, что коэффициент не равен 0). Вы бы сказали, что коэффициент с р-значением, равным 0,01, например, статистически значимый для 99 % доверительного интервала; связанные переменные являются эффективным предсказателем. Переменные с коэффициентами около 0 не помогают предсказать или смоделировать зависимые величины; они практически всегда удаляются из регрессионного уравнения, если только нет веских причин сохранить их.

R2/R-квадрат: Статистические показатели составной R-квадрат и скорректированный R-квадрат вычисляются из регрессионного уравнения, чтобы качественно оценить модель. Значение R-квадрат лежит в пределах от 0 до 100 процентов. Если ваша модель описывает наблюдаемые зависимые переменные идеально, R-квадрат равен 1. 0 (и вы, несомненно, сделали ошибку; возможно, вы использовали модификацию величины у для предсказания у). Вероятнее всего, вы увидите значения R-квадрат в районе 0,49, например, вы можете интерпретировать подобный результат как «Это модель объясняет 49 % вариации зависимой величины». Чтобы понять, как работает R-квадрат, постройте график, отражающий наблюдаемые и оцениваемые значения у, отсортированные по оцениваемым величинам. Обратите внимание на количество совпадений. Этот график визуально отображает, насколько хорошо вычисленные значения модели объясняют изменения наблюдаемых значений зависимых переменных. Просмотрите иллюстрацию. Скорректированный R-квадрат всегда немного меньше, чем множественный R-квадрат, т.к. он отражает всю сложность модели (количество переменных) и связан с набором исходных данных. Следовательно, скорректированный R-квадрат является более точной мерой для оценки результатов работы модели.

0 (и вы, несомненно, сделали ошибку; возможно, вы использовали модификацию величины у для предсказания у). Вероятнее всего, вы увидите значения R-квадрат в районе 0,49, например, вы можете интерпретировать подобный результат как «Это модель объясняет 49 % вариации зависимой величины». Чтобы понять, как работает R-квадрат, постройте график, отражающий наблюдаемые и оцениваемые значения у, отсортированные по оцениваемым величинам. Обратите внимание на количество совпадений. Этот график визуально отображает, насколько хорошо вычисленные значения модели объясняют изменения наблюдаемых значений зависимых переменных. Просмотрите иллюстрацию. Скорректированный R-квадрат всегда немного меньше, чем множественный R-квадрат, т.к. он отражает всю сложность модели (количество переменных) и связан с набором исходных данных. Следовательно, скорректированный R-квадрат является более точной мерой для оценки результатов работы модели.

Невязки: Существует необъяснимое количество зависимых величин, представленных в уравнении регрессии как случайные ошибки ε. См. рисунок. Известные значения зависимой переменной используются для построения и настройки модели регрессии. Используя известные величины зависимой переменной (Y) и известные значений для всех независимых переменных (Хs), регрессионный инструмент создаст уравнение, которое предскажет те известные у-значения как можно лучше. Однако предсказанные значения редко точно совпадают с наблюдаемыми величинами. Разница между наблюдаемыми и предсказываемыми значениями у называется невязка или отклонение. Величина отклонений регрессионного уравнения — одно из измерений качества работы модели. Большие отклонения говорят о ненадлежащем качестве модели.

Создание регрессионной модели представляет собой итерационный процесс, направленный на поиск эффективных независимых переменных, чтобы объяснить зависимые переменные, которые вы пытаетесь смоделировать или понять, запуская инструмент регрессии, чтобы определить, какие величины являются эффективными предсказателями. Затем пошаговое удаление и/или добавление переменных до тех пор, пока вы не найдете наилучшим образом подходящую регрессионную модель. Т.к. процесс создания модели часто исследовательский, он никогда не должен становиться простым «подгоном» данных. Он должен учитывать теоретические аспекты, мнение экспертов в этой области и здравый смысл. Вы должным быть способны определить ожидаемую взаимосвязь между каждой потенциальной независимой переменной и зависимой величиной до непосредственного анализа, и должны задать себе дополнительные вопросы, когда эти связи не совпадают.

Затем пошаговое удаление и/или добавление переменных до тех пор, пока вы не найдете наилучшим образом подходящую регрессионную модель. Т.к. процесс создания модели часто исследовательский, он никогда не должен становиться простым «подгоном» данных. Он должен учитывать теоретические аспекты, мнение экспертов в этой области и здравый смысл. Вы должным быть способны определить ожидаемую взаимосвязь между каждой потенциальной независимой переменной и зависимой величиной до непосредственного анализа, и должны задать себе дополнительные вопросы, когда эти связи не совпадают.

Особенности регрессионного анализа

Регрессия МНК – это простой метод анализа с хорошо проработанной теорией, предоставляющий эффективные возможности диагностики, которые помогут вам интерпретировать результаты и устранять неполадки. Однако, МНК надежен и эффективен, если ваши данные и регрессионная модель удовлетворяют всем предположениям, требуемым для этого метода (смотри таблицу внизу). Пространственные данные часто нарушают предположения и требования МНК, поэтому важно использовать инструменты регрессии в союзе с подходящими инструментами диагностики, которые позволяют оценить, является ли регрессия подходящим методом для вашего анализа, а приведенная структура данных и модель может быть применена.

Как регрессионная модель может не работать

Серьезной преградой для многих регрессионных моделей является ошибка спецификации. Модель ошибки спецификации — это такая неполная модель, в которой отсутствуют важные независимые переменные, поэтому она неадекватно представляет то, что мы пытаемся моделировать или предсказывать (зависимую величину, у). Другими словами, регрессионная модель не рассказывает вам всю историю. Ошибка спецификации становится очевидной, когда в отклонениях вашей регрессионной модели наблюдается статистически значимая пространственная автокорреляция, или другими словами, когда отклонения вашей модели кластеризуются в пространстве (недооценки – в одной области изучаемой территории, а переоценки – в другой). Благодаря картографированию отклонений регрессии или коэффициентов, связанных с географически взвешенной регрессией, вы сможете обратить ваше внимание на какие-то нюансы, которые вы упустили ранее. Запуск Анализа горячих точек по отклонениям регрессии также может раскрыть разные пространственные режимы, которые можно моделировать при помощи метода наименьших квадратов с региональными показателями или исправлять с использованием географически взвешенной регрессии. Предположим, когда вы картографируете отклонения вашей регрессионной модели, вы видите, что модель всегда заново предсказывает значения в горах, и, наоборот, в долинах, что может значить, что отсутствуют данные о рельефе. Однако может случиться так, что отсутствующие переменные слишком сложны для моделирования или их невозможно подсчитать или слишком трудно измерить. В этих случаях, вы можете воспользоваться ГВР (географически взвешенной регрессией) или другой пространственной регрессией, чтобы получить хорошую модель.

Благодаря картографированию отклонений регрессии или коэффициентов, связанных с географически взвешенной регрессией, вы сможете обратить ваше внимание на какие-то нюансы, которые вы упустили ранее. Запуск Анализа горячих точек по отклонениям регрессии также может раскрыть разные пространственные режимы, которые можно моделировать при помощи метода наименьших квадратов с региональными показателями или исправлять с использованием географически взвешенной регрессии. Предположим, когда вы картографируете отклонения вашей регрессионной модели, вы видите, что модель всегда заново предсказывает значения в горах, и, наоборот, в долинах, что может значить, что отсутствуют данные о рельефе. Однако может случиться так, что отсутствующие переменные слишком сложны для моделирования или их невозможно подсчитать или слишком трудно измерить. В этих случаях, вы можете воспользоваться ГВР (географически взвешенной регрессией) или другой пространственной регрессией, чтобы получить хорошую модель.

В следующей таблице перечислены типичные проблемы с регрессионными моделями и инструменты в ArcGIS:

Типичные проблемы с регрессией, последствия и решения

Ошибки спецификации относительно независимых переменных. | Когда ключевые независимые переменные отсутствуют в регрессионном анализе, коэффициентам и связанным с ними р-значениям нельзя доверять. | Создайте карту и проверьте невязки МНК и коэффициенты ГВР или запустите Анализ горячих точек по регрессионным невязкам МНК, чтобы увидеть, насколько это позволяет судить о возможных отсутствующих переменных. |

Нелинейные взаимосвязи. Просмотрите иллюстрацию. | МНК и ГВР – линейные методы. | Создайте диаграмму рассеяния, чтобы выявить взаимосвязи между показателями в модели.Уделите особое внимание взаимосвязям, включающим зависимые переменные. Обычно криволинейность может быть устранена трансформированием величин. Просмотрите иллюстрацию. Альтернативно, используйте нелинейный метод регрессии. |

Выбросы данных. Просмотрите иллюстрацию. | Существенные выбросы могут увести результаты взаимоотношений регрессионной модели далеко от реальности, внося ошибку в коэффициенты регрессии. | Создайте диаграмму рассеяния и другие графики (гистограммы), чтобы проверить экстремальные значения данных. Скорректировать или удалить выбросы, если они представляют ошибки. Когда выбросы соответствуют действительности, они не могут быть удалены. Запустить регрессию с и без выбросов, чтобы оценить, как это влияет на результат. |

Нестационарность. Вы можете обнаружить, что входящая переменная, может иметь сильную зависимость в регионе А, и в то время быть незначительной или даже поменять знак в регионе B (см. рисунок). | Если взаимосвязь между вашими зависимыми и независимыми величинами противоречит в пределах вашей области изучения, рассчитанные стандартные ошибки будут искусственно раздуты. | Инструмент МНК в ArcGIS автоматически тестирует проблемы, связанные с нестационарностью (региональными вариациями) и вычисляет устойчивые стандартные значения ошибок. Просмотрите иллюстрацию. |

Мультиколлинеарность. Одна или несколько независимых переменных излишни. Просмотрите иллюстрацию. | Мультиколлинеарность ведет к переоценке и нестабильной/ненадежной модели. | Инструмент МНК в ArcGIS автоматически проверяет избыточность. Каждой независимой переменной присваивается рассчитанная величина фактора, увеличивающего дисперсию. Когда это значение велико (например, > 7,5), избыток является проблемой и излишние показатели должны быть удалены из модели или модифицированы путем создания взаимосвязанных величин или увеличением размера выборки. Просмотрите иллюстрацию. |

Противоречивая вариация в отклонениях. Может произойти, что модель хорошо работает для маленьких величин, но становится ненадежна для больших значений. Просмотрите иллюстрацию. | Когда модель плохо предсказывает некоторые группы значений, результаты будут носить ошибочный характер. | Инструмент МНК в ArcGIS автоматически выполняет тест на несистемность вариаций в отклонениях (называемая гетероскедастичность или неоднородность дисперсии) и вычисляет стандартные ошибки, которые устойчивы к этой проблеме. Когда вероятности, связанные с тестом Koenker, малы (например, 0,05), необходимо учитывать устойчивые вероятности, чтобы определить, является ли независимая переменная статистически значимой или нет. |

Пространственно автокоррелированные отклонения. Просмотрите иллюстрацию. | Когда наблюдается пространственная кластеризация в отклонениях, полученных в результате работы модели, это означает, что имеется переоценённый тип систематических отклонений, модель работает ненадежно. | Запустите инструмент Пространственная автокорреляция (Spatial Autocorrelation) по отклонениям, чтобы убедиться, что в них не наблюдается статистически значимой пространственной автокорреляции. Статистически значимая пространственная автокорреляция практически всегда является симптомом ошибки спецификации (отсутствует ключевой показатель в модели). Просмотрите иллюстрацию. |

Нормальное распределение систематической ошибки. Просмотрите иллюстрацию. | Когда невязки регрессионной модели распределены ненормально со средним, близким к 0, р-значения, связанные с коэффициентами, ненадежны. | Инструмент МНК в ArcGIS автоматически выполняет тест на нормальность распределения отклонений. Когда статистический показатель Жака-Бера является значимым (например, 0,05), скорее всего в вашей модели отсутствует ключевой показатель (ошибка спецификации) или некоторые отношения, которые вы моделируете, являются нелинейными. Проверьте карту отклонений и возможно карту с коэффициентами ГВР, чтобы определить, какие ключевые показатели отсутствуют. Просмотр диаграмм рассеяния и поиск нелинейных отношений. |

Важно протестировать модель на каждую из проблем, перечисленных выше. Результаты могут быть на 100 % неправильны, если игнорируются проблемы, упомянутые выше.

Пространственная регрессия

Для пространственных данных характерно 2 свойства, которые затрудняют (не делают невозможным) применение традиционных (непространственных) методов, таких как МНК:

- Географические объекты довольно часто пространственно автокоррелированы. Это означает, что объекты, расположенные ближе друг к другу более похожи между собой, чем удаленные объекты. Это создает переоцененный тип систематических ошибок для традиционных моделей регрессии.

- География важна, и часто наиболее важные процессы нестационарны. Эти процессы протекают по-разному в разных частях области изучения. Эта характеристика пространственных данных может относиться как к региональным вариациям, так и к нестационарности.

Настоящие методы пространственной регрессии были разработаны, чтобы устойчиво справляться с этими двумя характеристиками пространственных данных и даже использовать эти свойства пространственных данных, чтобы улучшать моделирование взаимосвязей. Некоторые методы пространственной регрессии эффективно имеют дело с 1 характеристикой (пространственная автокорреляция), другие – со второй (нестационарность). В настоящее время, нет методов пространственной регрессии, которые эффективны с обеими характеристиками. Для правильно настроенной модели ГВР пространственная автокорреляция обычно не является проблемой.

Пространственная автокорреляция

Существует большая разница в том, как традиционные и пространственные статистические методы смотрят на пространственную автокорреляцию. Традиционные статистические методы видят ее как плохую вещь, которая должна быть устранена, т.к. пространственная автокорреляция ухудшает предположения многих традиционных статистических методов. Для географа или ГИС-аналитика, однако, пространственная автокорреляция является доказательством важности пространственных процессов; это интегральная компонента данных. Удаляя пространство, мы удаляем пространственный контекст данных; это как только половина истории. Пространственные процессы и доказательство пространственных взаимосвязей в данных представляют собой особый интерес, и поэтому пользователи ГИС с радостью используют инструменты пространственного анализа данных. Однако, чтобы избежать переоцененный тип систематических ошибок в вашей модели, вы должны определить полный набор независимых переменных, которые эффективно опишут структуру ваших данных. Если вы не можете определить все эти переменные, скорее всего, вы увидите существенную пространственную автокорреляцию среди отклонений модели. К сожалению, вы не можете доверять результатам регрессии, пока все не устранено. Используйте инструмент Пространственная автокорреляция, чтобы выполнить тест на статистически значимую пространственную автокорреляцию для отклонений в вашей регрессии.

Пространственные процессы и доказательство пространственных взаимосвязей в данных представляют собой особый интерес, и поэтому пользователи ГИС с радостью используют инструменты пространственного анализа данных. Однако, чтобы избежать переоцененный тип систематических ошибок в вашей модели, вы должны определить полный набор независимых переменных, которые эффективно опишут структуру ваших данных. Если вы не можете определить все эти переменные, скорее всего, вы увидите существенную пространственную автокорреляцию среди отклонений модели. К сожалению, вы не можете доверять результатам регрессии, пока все не устранено. Используйте инструмент Пространственная автокорреляция, чтобы выполнить тест на статистически значимую пространственную автокорреляцию для отклонений в вашей регрессии.

Как минимум существует 3 направления, как поступать с пространственной автокорреляцией в невязках регрессионных моделей.

- Изменять размер выборки до тех пор, пока не удастся устранить статистически значимую пространственную автокорреляцию. Это не гарантирует, что в анализе будет полностью устранена проблема пространственной автокорреляции, но она значительно меньше, когда пространственная автокорреляция удалена из зависимых и независимых переменных. Это традиционный статистический подход к устранению пространственной автокорреляции и только подходит, если пространственная автокорреляция является результатом избыточности данных.

- Изолируйте пространственные и непространственные компоненты каждой входящей величины, используя методы фильтрации в пространственной регрессии. Пространство удалено из каждой величины, но затем его возвращают обратно в регрессионную модель в качестве новой переменной, отвечающей за пространственные эффекты/пространственную структуру. ArcGIS в настоящее время не предоставляет возможности проведения подобного рода анализа.

- Внедрите пространственную автокорреляцию в регрессионную модель, используя пространственные эконометрические регрессионные модели.

Пространственные эконометрические регрессионные модели будут добавлены в ArcGIS в следующем релизе.

Пространственные эконометрические регрессионные модели будут добавлены в ArcGIS в следующем релизе.

Региональные вариации

Глобальные модели, подобные МНК, создают уравнения, наилучшим образом описывающие общие связи в данных в пределах изучаемой территории. Когда те взаимосвязи противоречивы в пределах территории изучения, МНК хорошо моделирует эти взаимосвязи. Когда те взаимосвязи ведут себя по-разному в разных частях области изучения, регрессионное уравнение представляет средние результаты, и в случае, когда те взаимосвязи представляют 2 экстремальных значения, глобальное среднее не моделирует хорошо эти значения. Когда ваши независимые переменные испытывают нестационарность (региональные вариации), глобальные модели не подходят, а необходимо использовать устойчивые методы регрессионного анализа. Идеально, вы сможете определить полный набор независимых переменных, чтобы справиться с региональными вариациями в ваших зависимых переменных. Если вы не сможете определить все пространственные переменные, вы снова заметите статистически значимую пространственную автокорреляцию в ваших отклонениях и/или более низкие, чем ожидалось, значения R-квадрат. К сожалению, вы не можете доверять результатам регрессии, пока все не устранено.

Существует как минимум 4 способа работы с региональными вариациями в МНК регрессионных моделях:

- Включить переменную в модель, которая объяснит региональные вариации. Если вы видите, что ваша модель всегда «перепредсказывает» на севере и «недопредсказывает» на юге, добавьте набор региональных значений:1 для северных объектов, и 0 для южных объектов.

- Используйте методы, которые включают региональные вариации в регрессионную модель, такие как Географически взвешенная регрессия.

- Примите во внимание устойчивые стандартные отклонения регрессии и вероятности, чтобы определить, являются ли коэффициенты статистически значимыми. ГВР рекомендуется

- Изменить/сократить размер области изучения так, чтобы процессы в пределах новой области изучения были стационарными (не испытывали региональные вариации).

Дополнительные ресурсы

Для большей информации по использованию регрессионных инструментов, см.:

Связанные разделы

Отзыв по этому разделу?

5 видов регрессии и их свойства. При помощи построения регрессионных… | by Margarita M | NOP::Nuances of Programming

Линейная и логистическая регрессии обычно являются первыми видами регрессии, которые изучают в таких областях, как машинное обучение и наука о данных. Оба метода считаются эффективными, так как их легко понять и использовать. Однако, такая простота также имеет несколько недостатков, и во многих случаях лучше выбирать другую регрессионную модель. Существует множество видов регрессии, каждый из которых имеет свои достоинства и недостатки.

Мы познакомимся с 7 наиболее распространенными алгоритмами регрессии и опишем их свойства. Также мы узнаем, в каких ситуация и с какими видами данных лучше использовать тот или иной алгоритм. В конце мы расскажем о некоторых инструментах для построения регрессии и поможем лучше разобраться в регрессионных моделях в целом!

Линейная регрессияРегрессия — это метод, используемый для моделирования и анализа отношений между переменными, а также для того, чтобы увидеть, как эти переменные вместе влияют на получение определенного результата. Линейная регрессия относится к такому виду регрессионной модели, который состоит из взаимосвязанных переменных. Начнем с простого. Парная (простая) линейная регрессия — это модель, позволяющая моделировать взаимосвязь между значениями одной входной независимой и одной выходной зависимой переменными с помощью линейной модели, например, прямой.

Более распространенной моделью является множественная линейная регрессия, которая предполагает установление линейной зависимости между множеством входных независимых и одной выходной зависимой переменных. Такая модель остается линейной по той причине, что выход является линейной комбинацией входных переменных. Мы можем построить модель множественной линейной регрессии следующим образом:

Мы можем построить модель множественной линейной регрессии следующим образом:

Y = a_1*X_1 + a_2*X_2 + a_3*X_3 ……. a_n*X_n + b

Где a_n — это коэффициенты, X_n — переменные и b — смещение. Как видим, данная функция не содержит нелинейных коэффициентов и, таким образом, подходит только для моделирования линейных сепарабельных данных. Все очень просто: мы взвешиваем значение каждой переменной X_n с помощью весового коэффициента a_n. Данные весовые коэффициенты a_n, а также смещение b вычисляются с применением стохастического градиентного спуска. Посмотрите на график ниже в качестве иллюстрации!

Иллюстрация поиска оптимальных параметром для линейной регрессии с помощью градиентного спускаНесколько важных пунктов о линейной регрессии:

- Она легко моделируется и является особенно полезной при создании не очень сложной зависимости, а также при небольшом количестве данных.

- Обозначения интуитивно-понятны.

- Чувствительна к выбросам.

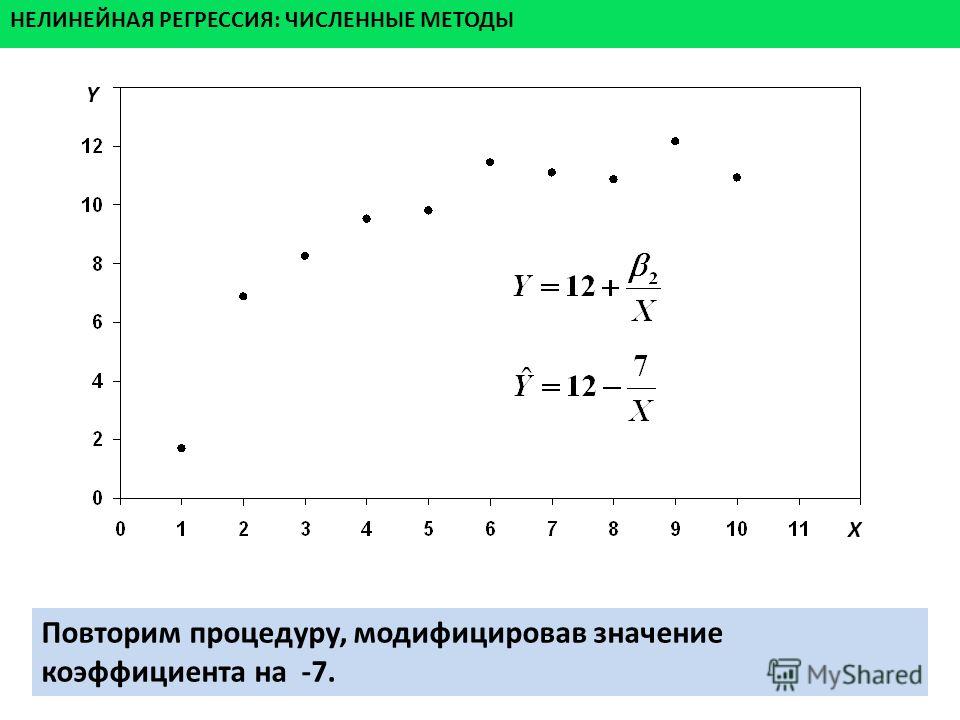

Для создания такой модели, которая подойдет для нелинейно разделяемых данных, можно использовать полиномиальную регрессию. В данном методе проводится кривая линия, зависимая от точек плоскости. В полиномиальной регрессии степень некоторых независимых переменных превышает 1. Например, получится что-то подобное:

Y = a_1*X_1 + (a_2)²*X_2 + (a_3)⁴*X_3 ……. a_n*X_n + b

У некоторых переменных есть степень, у других — нет. Также можно выбрать определенную степень для каждой переменной, но для этого необходимы определенные знания о том, как входные данные связаны с выходными. Сравните линейную и полиномиальную регрессии ниже.

Линейная и полиномиальная регрессии с нелинейно разделенными даннымиНесколько важных пунктов о полиномиальной регрессии:

- Моделирует нелинейно разделенные данные (чего не может линейная регрессия). Она более гибкая и может моделировать сложные взаимосвязи.

- Полный контроль над моделированием переменных объекта (выбор степени).

- Необходимо внимательно создавать модель. Необходимо обладать некоторыми знаниями о данных, для выбора наиболее подходящей степени.

- При неправильном выборе степени, данная модель может быть перенасыщена.

В случае высокой коллинеарности переменных стандартная линейная и полиномиальная регрессии становятся неэффективными. Коллинеарность — это отношение независимых переменных, близкое к линейному. Наличие высокой коллинеарности можно определить несколькими путями:

- Коэффициент регрессии не важен, несмотря на то, что, теоретически, переменная должна иметь высокую корреляцию с Y.

- При добавлении или удалении переменной из матрицы X, коэффициент регрессии сильно изменяется.

- Переменные матрицы X имеют высокие попарные корреляции (посмотрите корреляционную матрицу).

Сначала можно посмотреть на функцию оптимизации стандартной линейной регрессии для лучшего понимания того, как может помочь гребневая регрессия:

min || Xw — y ||²

Где X — это матрица переменных, w — веса, y — достоверные данные. Гребневая регрессия — это корректирующая мера для снижения коллинеарности среди предикторных переменных в регрессионной модели. Коллинеарность — это явление, в котором одна переменная во множественной регрессионной модели может быть предсказано линейно, исходя из остальных свойств со значительной степенью точности. Таким образом, из-за высокой корреляции переменных, конечная регрессионная модель сведена к минимальным пределам приближенного значения, то есть она обладает высокой дисперсией.

Гребневая регрессия добавляет небольшой фактор квадратичного смещения для уменьшения дисперсии:

min || Xw — y ||² + z|| w ||²

Такой фактор смещения выводит коэффициенты переменных из строгих ограничений, вводя в модель небольшое смещение, но при этом значительно снижая дисперсию.

Несколько важных пунктов о гребневой регрессии:

- Допущения данной регрессии такие же, как и в методе наименьших квадратов, кроме того факта, что нормальное распределение в гребневой регрессии не предполагается.

- Это уменьшает значение коэффициентов, оставляя их ненулевыми, что предполагает отсутствие отбора признаков.

В регрессии лассо, как и в гребневой, мы добавляем условие смещения в функцию оптимизации для того, чтобы уменьшить коллинеарность и, следовательно, дисперсию модели. Но вместо квадратичного смещения, мы используем смещение абсолютного значения:

min || Xw — y ||² + z|| w ||

Существует несколько различий между гребневой регрессией и лассо, которые восстанавливают различия в свойствах регуляризаций L2 и L1:

- Встроенный отбор признаков — считается полезным свойством, которое есть в норме L1, но отсутствует в норме L2. Отбор признаков является результатом нормы L1, которая производит разреженные коэффициенты. Например, предположим, что модель имеет 100 коэффициентов, но лишь 10 из них имеют коэффициенты отличные от нуля. Соответственно, «остальные 90 предикторов являются бесполезными в прогнозировании искомого значения». Норма L2 производит неразряженные коэффициенты и не может производить отбор признаков. Таким образом, можно сказать, что регрессия лассо производит «выбор параметров», так как не выбранные переменные будут иметь общий вес, равный 0.

- Разряженность означает, что незначительное количество входных данных в матрице (или векторе) имеют значение, отличное от нуля. Норма L1 производит большое количество коэффициентов с нулевым значением или очень малые значения с некоторыми большими коэффициентами. Это связано с предыдущим пунктом, в котором указано, что лассо исполняет выбор свойств.

- Вычислительная эффективность: норма L1 не имеет аналитического решения в отличие от нормы L2. Это позволяет эффективно вычислять решения нормы L2.

Однако, решения нормы L1 не обладают свойствами разряженности, что позволяет использовать их с разряженными алгоритмами для более эффективных вычислений.

Однако, решения нормы L1 не обладают свойствами разряженности, что позволяет использовать их с разряженными алгоритмами для более эффективных вычислений.

Эластичная сеть — это гибрид методов регрессии лассо и гребневой регрессии. Она использует как L1, так и L2 регуляризации, учитывая эффективность обоих методов.

min || Xw — y ||² + z_1|| w || + z_2|| w ||²

Практическим преимуществом использования регрессии лассо и гребневой регрессии является то, что это позволяет эластичной сети наследовать некоторую стабильность гребневой регрессии при вращении.

Несколько важных пунктов о регрессии эластичной сети:

- Она создает условия для группового эффекта при высокой корреляции переменных, а не обнуляет некоторые из них, как метод лассо.

- Нет ограничений по количеству выбранных переменных.

Вот и все! 5 распространенных видов регрессии и их свойства. Все данные методы регуляризации регрессии (лассо, гребневая и эластичной сети) хорошо функционирует при высокой размерности и мультиколлинеарности среди переменных в наборе данных.

Перевод статьи George Seif: 5 Types of Regression and their properties

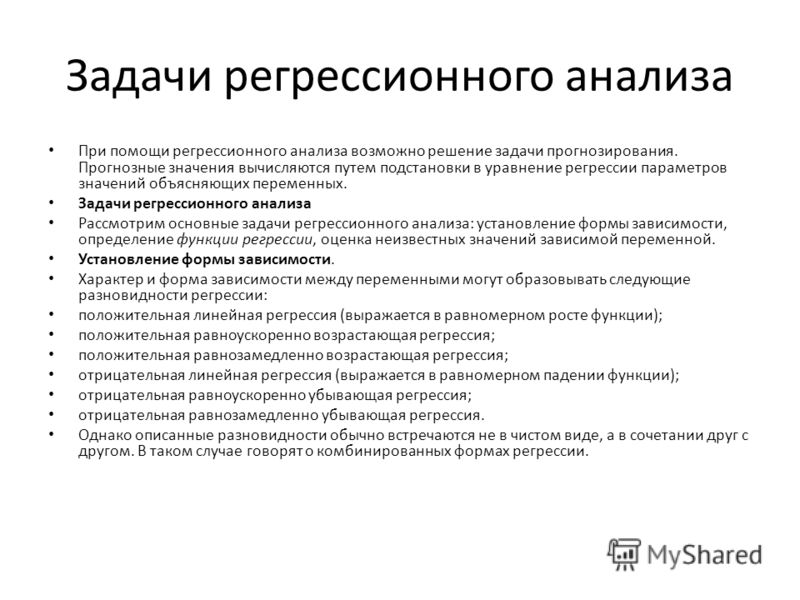

Парная линейная регрессия. Задачи регрессионного анализа

Будут и задачи для самостоятельного решения, к которым можно посмотреть ответы.

Линейная регрессия — выраженная в виде прямой зависимость среднего значения какой-либо

величины от некоторой другой величины. В отличие от функциональной зависимости y = f(x),

когда каждому значению независимой переменной x соответствует одно определённое значение

величины

Если в результате наблюдения установлено, что при каждом определённом значении x существует сколько-то (n) значений переменной y, то зависимость средних арифметических значений y от x и является регрессией в статистическом понимании.

Если установленная зависимость может быть записана в виде уравнения прямой

y = ax +

то эта регрессионная зависимость называется линейной регрессией.

О парной линейной регрессии говорят, когда установлена зависимость между двумя переменными величинами (x и y). Парная линейная регрессия называется также однофакторной линейной регрессией, так как один фактор (независимая переменная x) влияет на результирующую переменную (зависимую переменную y).

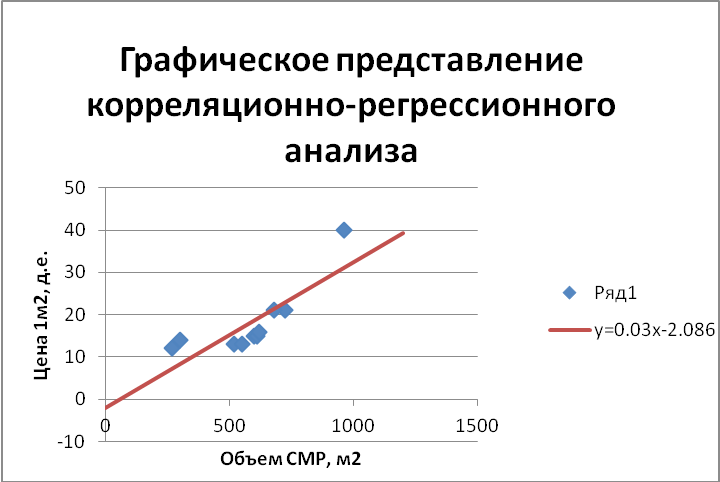

В уроке о корреляционной зависимости

были разобраны примеры того, как цена на квартиры зависит от общей площади квартиры и от площади

кухни (две различные независимые переменные) и о том, что результаты наблюдений расположены в некотором

приближении к прямой, хотя и не на самой прямой. Если точки корреляционной диаграммы соединить ломанной

линией, то будет получена

По этой прямой теоретической регрессии может быть сделан прогноз или восстановление неизвестных значений зависимой переменной по заданным значениям независимой переменной.

В случае парной линейной регрессии для данных генеральной совокупности связь между независимой переменной (факториальным признаком) X и зависимой переменной (результативным признаком) Y описывает модель

,

где

— свободный член прямой парной линейной регрессии,

— коэффициент направления прямой парной линейной регрессии,

— случайная погрешность,

N — число элементов генеральной совокупности.

Уравнение парной линейной регрессии для генеральной совокупности можно построить, если доступны данные обо всех элементах генеральной совокупности. На практике данные всей генеральной совокупности недоступны, но доступны данные об элементах некоторой выборки.

Поэтому параметры генеральной совокупности оценивают при помощи соответствующих параметров соответствующей выборки: свободный член прямой парной линейной регрессии генеральной совокупности заменяют на свободный член прямой парной линейной регрессии выборки , а коэффициент направления прямой парной линейной регрессии генеральной совокупности — на коэффициент направления прямой парной линейной регрессии выборки .

В результате получаем уравнение парной линейной регрессии выборки

или

где

— оценка полученной с помощью модели линейной регрессии зависимой переменной Y,

— погрешность,

n — размер выборки.

Чтобы уравнение парной линейной регрессии было более похоже на привычное уравнение прямой, его часто также записывают в виде

.

Определение коэффициентов уравнения парной линейной регрессии

Если заранее известно, что зависимость между факториальным признаком x и результативным признаком y должна быть линейной, выражающейся в виде уравнения типа , задача сводится к нахождению по некоторой группе точек наилучшей прямой, называемой прямой парной линейной регрессии. Следует найти такие значения коэффициентов a и b , чтобы сумма квадратов отклонений была наименьшей:

.

Если через и обозначить средние значения признаков X и Y,то полученная с помощью метода наименьших квадратов функция регрессии удовлетворяет следующим условиям:

Условие метода наименьших квадратов выполняется, если значения коэффициентов равны:

,

.

Пример 1. Найти уравнение парной линейной регрессии зависимости между валовым внутренним продуктом (ВВП) и частным потреблением на основе данных примера урока о корреляционной зависимости (эта ссылка, которая откроется в новом окне, потребуется и при разборе следующих примеров).

Решение. Используем рассчитанные в решении названного выше примера суммы:

Используя эти суммы, вычислим коэффициенты:

Таким образом получили уравнение прямой парной линейной регрессии:

Составить уравнение парной линейной регрессии самостоятельно, а затем посмотреть решение

Пример 2. Найти уравнение парной линейной регрессии для выборки из 6 наблюдений, если уже вычислены следующие промежуточные результаты:

;

;

;

;

Правильное решение и ответ.

Метод наименьших квадратов имеет по меньшей мере один существенный недостаток: с его помощью можно найти уравнение линейной регрессии и в тех случаях, когда данные наблюдений значительно рассеяны вокруг прямой регрессии, то есть находятся на значительном расстоянии от этой прямой. В таких случаях за точность прогноза значений зависимой переменной ручаться нельзя. Существуют показатели, которые позволяют оценить качество уравнения линейной регрессии прежде чем использовать модели линейной регрессии для практических целей. Разберём важнейшие из этих показателей.

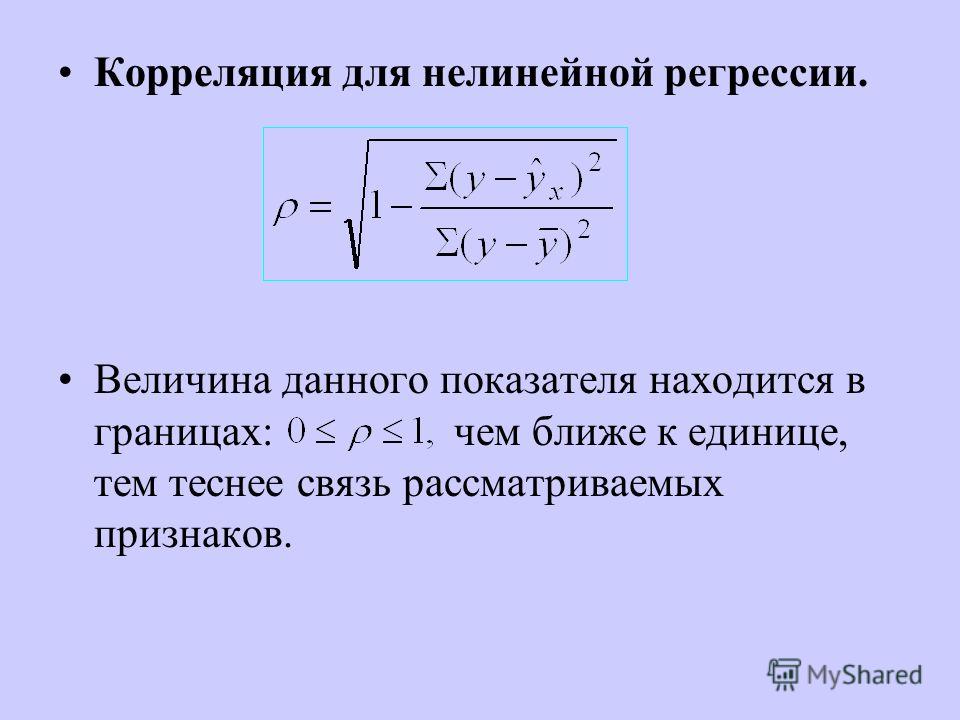

Коэффициент детерминации

Коэффициент детерминации

принимает значения от 0 до 1 и в случае качественной модели линейной регрессии стремится к единице. Коэффициент детерминации показывает, какую часть общего рассеяния зависимой переменной объясняет независимая переменная:

Коэффициент детерминации показывает, какую часть общего рассеяния зависимой переменной объясняет независимая переменная:

,

где

— сумма квадратов отклонений, объясняемых моделью линейной регрессии, которая характеризует рассеяние точек прямой регрессии относительно арифметического среднего,

— общая сумма квадратов отклонений, которая характеризует рассеяние зависимой переменной Y относительно арифметического среднего,

— сумма квадратов отклонений ошибки (не объясняемых моделью линейной регрессии), которая характеризует рассеяние зависимой переменной Y относительно прямой регресии.

Пример 3. Даны сумма квадратов отклонений, объясняемых моделью линейной регрессии (3500), общая сумма квадратов отклонений (5000) и сумма квадратов отклонений ошибки (1500). Найти коэффициент детерминации двумя способами.

Правильное решение и ответ.

F-статистика (статистика Фишера) для проверки качества модели линейной регрессии

Минимальное возможное значение F-статистики — 0. Чем выше значение статистики Фишера, тем качественнее модель линейной регрессии. Этот показатель представляет собой отношение объясненной суммы квадратов (в расчете на одну независимую переменную) к остаточной сумме квадратов (в расчете на одну степень свободы):

где m — число объясняющих переменных.

Сумма квадратов остатков

Сумма квадратов остатков (RSS) измеряет необъясненную часть дисперсии зависимой переменной:

где

—

остатки — разности между реальными значениями зависимой переменной и значениями,

оценёнными уравнением линейной регрессии.

В случае качественной модели линейной регрессии сумма квадратов остатков стремится к нулю.

Стандартная ошибка регрессии

Стандартная ошибка регрессии (SEE) измеряет величину квадрата ошибки, приходящейся на одну степень свободы модели:

Чем меньше значение SEE, тем качественнее модель.

Пример 4. Рассчитать коэффициент детерминации для данных из примера 1.

Решение. На основании данных таблицы (она была приведена в примере урока о корреляционной зависимости) получаем, что SST = 63 770,593, SSE = 10 459,587, SSR = 53 311,007.

Можем убедиться, что выполняется закономерность SSR = SST — SSE:

63770,593-10459,587=53311,007.

Получаем коэффициент детерминации:

.

Таким образом, 83,6% изменений частного потребления можно объяснить моделью линейной регресии.

Итак, уравнение парной линейной регрессии:

.

В этом уравнении a — свободный член, b — коэффициент при независимой переменной.

Интерпретация свободного члена: a показывает, на сколько единиц график регрессии смещён вверх при x=0, то есть значение переменной y при нулевом значении переменной x.

Интерпретация коэффициента при независимой переменной: b показывает, на сколько единиц изменится значение зависимой переменной y при изменении x на одну единицу.

Пример 5. Зависимость частного потребления граждан от ВВП (истолкуем это просто: от дохода)

описывается уравнением парной линейной регрессии . Сделать прогноз потребления при доходе в 20 000 у.е. Выяснить, на сколько увеливается потребление при

увеличении дохода на 5000 у.е. Меняется ли потребление, если доход не меняется?

Сделать прогноз потребления при доходе в 20 000 у.е. Выяснить, на сколько увеливается потребление при

увеличении дохода на 5000 у.е. Меняется ли потребление, если доход не меняется?

Решение. Подставляем в уравнение парной линейной регрессии xi = 20000 и получаем прогноз потребления при доходе в 20 000 у.е. yi = 17036,4662.

Подставляем в уравнение парной линейной регрессии xi = 5000 и получаем прогноз увеличения потребления при увеличении дохода на 5000 у.е. yi = 4161,9662.

Если доход не меняется, то xi = 0 и получаем, что потребление уменьшается на 129,5338 у.е.

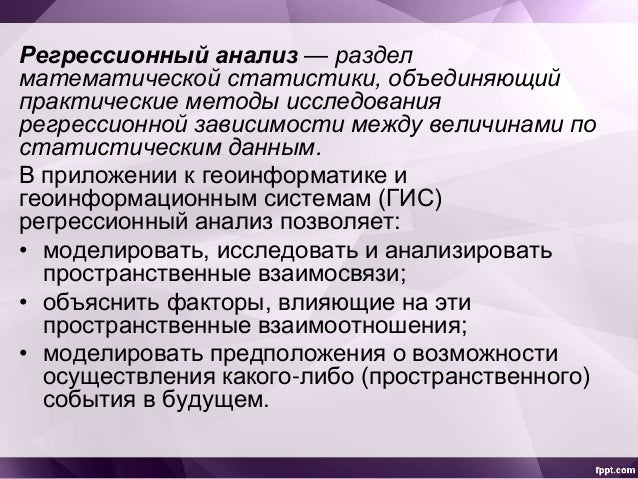

Регрессионный анализ — раздел математической статистики, объединяющий практические методы исследования регрессионной зависимости между величинами по статистическим данным.

Наиболее частые задачи регрессионного анализа:

- установление факта наличия или отсутствия статистических зависимостей между переменными величинами;

- выявление причинных связей между переменными величинами;

- прогноз или восстановление неизвестных значений зависимых переменных по заданным значениям независимых переменных.

Также делаются проверки статистических гипотез о регрессии. Кроме того, при изучении связи между двумя величинами по результатам наблюдений в соответствии с теорией регрессии предполагается, что зависимая переменная имеет некоторое распределение вероятностей при фиксированном значении независимой переменной.

В исследованиях поведения человека, чтобы они претендовали на объективность, важно не только установить зависимость между факторами, но и получить все необходимые статистические показатели для результата проверки соответствующей гипотезы.

Одна из важнейших гипотез в регрессионном анализе — гипотеза о том, что коэффициент

направления прямой регрессии генеральной совокупности

равен нулю.

Если это предположение верно, то изменения независимой переменной X не влияют на изменения зависимой переменной Y: переменные X и Y не коррелированы, то есть линейной зависимости Y от X нет.

Нулевую гипотезу

рассматривают во взаимосвязи с альтернативной гипотезой

.

Статистика коэффициента направления

соответствует распределению Стьюдента с числом степеней свободы v = n — 2,

где — стандартная погрешность коэффициента направления прямой линейной регресии b1.

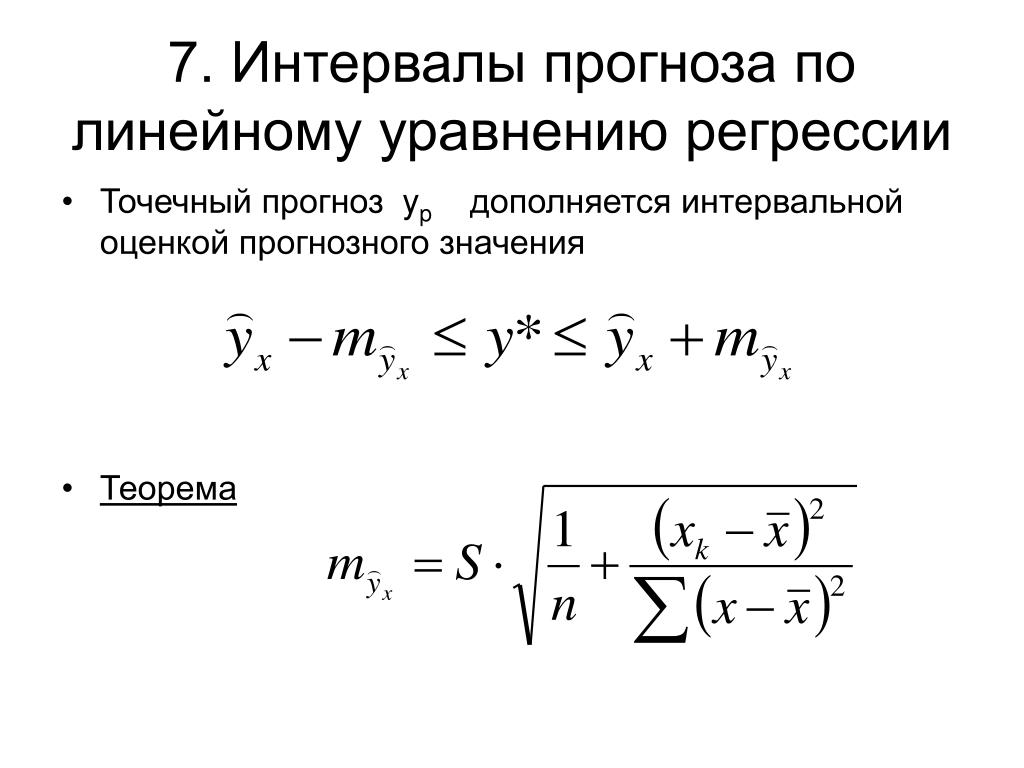

Доверительный интервал коэффициента направления прямой линейной регрессии:

.

Критическая область, в которой с вероятностью P = 1 — α отвергают нулевую гипотезу и принимают альтернативную гипотезу:

Пример 6. На основе данных из предыдущих примеров (о ВВП и частном потреблении) определить доверительный интервал коэффициента направления прямой линейной регресии 95% и проверить гипотезу о равенстве нулю коэффициента направления прямой парной линейной регрессии.

Можем рассчитать, что , а стандартная погрешность регрессии .

Таким образом, стандартная погрешность коэффициента направления прямой линейной регресии b1:

.

Так как и (находим по таблице в приложениях к учебникам по статистике), то доверительный интервал 95% коэффициента направления прямой парной линейной регрессии:

.

Так как гипотетическое значение коэффициента — нуль — не принадлежит доверительному интервалу, с вероятностью 95% можем отвергнуть основную гипотезу и принять альтернативную гипотезу, то есть считать, что зависимая переменная Y линейно зависит от независимой переменной X.

Всё по теме «Математическая статистика»

Статистика — Линейная регрессия — CoderLessons.com

После того, как степень взаимосвязи между переменными была установлена с использованием анализа взаимосвязи, естественно, углубиться в природу взаимосвязи. Регрессионный анализ помогает определить причинно-следственную связь между переменными. Можно предсказать значение других переменных (называемых зависимой переменной), если значения независимых переменных можно предсказать с помощью графического метода или алгебраического метода.

Графический метод

Он включает в себя построение диаграммы рассеяния с независимой переменной на оси X и зависимой переменной на оси Y. После этого линия рисуется таким образом, что она проходит через большую часть распределения, а оставшиеся точки распределены почти равномерно по обе стороны от линии.

Линия регрессии известна как линия наилучшего соответствия, которая суммирует общее движение данных. Он показывает наилучшие средние значения одной переменной, соответствующие средним значениям другой. Линия регрессии основана на критериях того, что это прямая линия, которая минимизирует сумму квадратов отклонений между прогнозируемыми и наблюдаемыми значениями зависимой переменной.

Алгебраический метод

Алгебраический метод строит два уравнения регрессии X на Y и Y на X.

Уравнение регрессии Y на X

Y=a+bX

Где —

-

Y = Зависимая переменная

-

X = Независимая переменная

-

a = Константа, показывающая Y-перехват

-

b = Константа, показывающая наклон линии

Y = Зависимая переменная

X = Независимая переменная

a = Константа, показывающая Y-перехват

b = Константа, показывающая наклон линии

Значения a и b получают с помощью следующих нормальных уравнений:

sumY=Na+b sumX[7pt] sumXY=a sumX+b sumX2

sumY=Na+b sumX[7pt] sumXY=a sumX+b sumX2

Где —

N = Количество наблюдений

Уравнение регрессии X на Y

X=a+bY

Где —

-

X = Зависимая переменная

-

Y = Независимая переменная

-

a = Константа, показывающая Y-перехват

-

b = Константа, показывающая наклон линии

X = Зависимая переменная

Y = Независимая переменная

a = Константа, показывающая Y-перехват

b = Константа, показывающая наклон линии

Значения a и b получают с помощью следующих нормальных уравнений:

sumX=Na+b sumY[7pt] sumXY=a sumY+b sumY2

sumX=Na+b sumY[7pt] sumXY=a sumY+b sumY2

Где —

N = Количество наблюдений

пример

Постановка задачи:

Исследователь обнаружил, что существует взаимосвязь между весовыми тенденциями отца и сына. В настоящее время он заинтересован в разработке уравнения регрессии по двум переменным по приведенным данным:

| Вес отца (в кг) | 69 | 63 | 66 | 64 | 67 | 64 | 70 | 66 | 68 | 67 | 65 | 71 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Вес сына (в кг) | 70 | 65 | 68 | 65 | 69 | 66 | 68 | 65 | 71 | 67 | 64 | 72 |

развивать

-

Уравнение регрессии Y на X.

-

Уравнение регрессии по Y.